Guía crítica para el Uso Profesional de la IA: Límites, Riesgos y Buenas Prácticas

La IA funciona mejor cuanto más profesionales somos: nos potencia y amplía nuestras capacidades. Sus resultados pueden deslumbrarnos, especialmente cuando consultamos materias que no dominamos, por lo que es necesario velar para que sean adecuados. Esto implica aplicar técnicas específicas para sacar el máximo rendimiento a la IA, revisar los resultados y conocer las posibles limitaciones propias de la IA.

Esta guía pretende ayudar a comprender y mejorar los resultados que obtenemos de la IA a partir de un uso profesional, crítico y consciente.

1. Supervisión y criterio: la IA como copiloto, nunca como piloto principal

–Análisis: de momento, la IA no razona, predice qué palabra tiene más sentido que venga a continuación. Esto provoca alucinaciones (invenciones plausibles pero falsas). Sobre todo cuando la utilizamos para un uso profesional, la responsabilidad civil, penal y deontológica recae exclusivamente en el profesional humano que la utiliza.

Otro riesgo es que las IA están diseñadas para responder a las demandas de información de manera que se ajusten al máximo a las necesidades del usuario. Esto puede generar respuestas sesgadas o equivocadas, un fenómeno conocido como factor de complacencia, que también es un sesgo de la IA. Por ello, es importante pedir siempre a la IA que sea objetiva y aplicar nuestro espíritu crítico y conocimiento profesional en la evaluación de sus resultados.

–Recomendación práctica: aplica siempre la regla del Human-in-the-loop (humano en el bucle). Verifica cualquier dato, ley, jurisprudencia o cálculo de manera independiente. Si la IA te cita un artículo o un libro, búscalo en la fuente original antes de utilizarlo.

2. Sesgo algorítmico y alineamiento: la ilusión de la neutralidad

–Análisis: la IA está programada y entrenada con datos que incorporan prejuicios e intereses económicos, empresariales, políticos e ideológicos, por lo que refleja esos sesgos en sus respuestas. Además, las empresas aplican filtros de seguridad (conocidos como alineamiento) para evitar contenido peligroso o tóxico, lo que puede derivar en respuestas excesivamente asépticas, sesgadas hacia la moralidad corporativa o, en ciertos casos, en una censura sutil de debates legítimos. La IA no es el gurú de la verdad.

–Recomendación práctica: mantén una mirada escéptica y crítica. Si tratas un tema complejo, pide explícitamente a la IA que te muestre argumentos contrarios (por ejemplo: “Actúa como un abogado de la parte contraria y critica este argumento”). Esto ayuda a romper el eco informativo.

Otro riesgo es que las IA están diseñadas para responder a las demandas de información de manera que se ajusten al máximo a las necesidades del usuario. Esto puede generar respuestas sesgadas o equivocadas, un fenómeno conocido como factor de complacencia, que también es un sesgo de la IA. Por ello, es importante pedir siempre a la IA que sea objetiva y aplicar nuestro espíritu crítico y conocimiento profesional en la evaluación de sus resultados.

3. El valor añadido: la barrera del conocimiento oculto

–Análisis: los modelos de IA están entrenados con datos públicos. Las bases de datos de pago, monografías técnicas, jurisprudencia muy reciente o, sobre todo, el contexto específico de tu sector y cliente, quedan fuera de su alcance. Si confías solo en la IA, tu trabajo será estándar y mediocre.

–Recomendación práctica: utiliza la IA para la estructura (el esqueleto) o para superar el bloqueo de la hoja en blanco, pero el “músculo” (el análisis crítico, las fuentes especializadas y la estrategia) debes aportarlo tú. Tu valor diferencial es aquello que la IA no sabe. No olvides consultar otro tipo de documentación que no está en el fondo de conocimiento de la IA, como monografías y artículos.

La IA es más precisa cuando se utilizan fuentes de información propias. Por ejemplo, en el ámbito del derecho, se puede cargar una sentencia concreta para que redacte un recurso basado en ese documento.

4. Confidencialidad y privacidad: el riesgo de la exposición de datos

–Análisis: las herramientas gratuitas y algunas de pago utilizan por defecto los chats de los usuarios para reentrenar sus modelos (normalmente, cuanto más cara es una versión de IA, más protege la privacidad). Introducir datos sensibles (nombres de clientes, secretos industriales, contratos) rompe frontalmente la cláusula de confidencialidad y el RGPD.

–Recomendación práctica: establece una política de “Confianza Cero” (Zero Trust). Anonimiza siempre la información (sustituye “Empresa X” por “Empresa de retail”, o “Juan Pérez” por “Cliente A”). Si tu volumen de trabajo lo requiere, invierte en licencias de IA corporativas donde por contrato se garantice que tus datos no se usan para entrenar modelos.

Recuerda configurar la IA para mantener al máximo la privacidad de los datos.

Existe también la opción de disponer de una IA en local para proteger la privacidad de nuestra documentación y datos. En este caso, la IA no es tan eficiente y se necesitan ordenadores potentes.

5. Personalización: huir de la homogeneización y del tono robótico

–Análisis: la IA tiende a escribir con estructuras repetitivas, uso excesivo de ciertos adjetivos o listas estandarizadas. Esto diluye tu marca personal y hace evidente que el texto no es genuino.

–Recomendación práctica: antes de pedir que redacte algo, proporciónale ejemplos de textos tuyos previos. Usa prompts como: “Analiza el estilo, el tono y el vocabulario de este texto mío. Ahora, redacta la nueva respuesta imitando exactamente este estilo”. Aun así, reserva la edición final para pulirlo con tu propia voz.

6. Ingeniería de prompts (profundización): el diálogo iterativo

–Análisis: más que un prompt “pesado”, un buen prompt debe ser contextualizado, preciso e iterativo. Esperar que la IA haga un trabajo excelente con una sola instrucción simple es un error de principiante.

–Recomendación práctica: utiliza el enfoque de “Cadena de Pensamiento” (Chain of Thought). No le pidas el documento final; pídele primero un esquema. Revisa el esquema. Después, pídele que desarrolle el punto 1. Revísalo. Dale feedback sobre qué ha hecho mal y pídele el punto 2. Este proceso conversacional extrae mucho más potencial de la herramienta.

Una vez tengamos el resultado, pídele que reevalúe la respuesta (que vuelva a pensar y redactar el resultado), o utiliza una segunda IA para que corrija los resultados de la primera.

Podemos utilizar la propia IA para ayudarnos a crear los prompts. Esto se denomina metaprompting.

Un buen prompt y una buena estrategia de consulta son básicos para obtener un buen resultado.

7. Seleccionar la IA adecuada

–Análisis: dependiendo de nuestras necesidades, debemos seleccionar entre una IA generalista (multimodal), una especializada (por ejemplo, en vídeo) o una temática (como en derecho o medicina). Cada opción presenta ventajas e inconvenientes, y su elección dependerá de nuestro propósito y de si el uso es profesional o personal.

Normalmente, las herramientas especializadas y temáticas suelen ser más caras, y aquí también hay que valorar qué retorno pueden ofrecernos en relación con la inversión.

–Recomendación práctica: antes de contratar una herramienta, conviene definir claramente para qué la necesitamos, probar diferentes opciones y valorar cuál se adapta mejor a nuestro flujo de trabajo, al presupuesto disponible y al nivel de calidad que exigimos. No obstante, estas herramientas son complementarias y no excluyentes.

Un factor importante de las IA temáticas, como las de derecho, es que suelen proteger mejor la privacidad de los datos.

8. Riesgos

–Degradación de habilidades (Skill Fade): un riesgo profesional a largo plazo es perder la capacidad de pensar desde cero o estructurar ideas por delegarlo demasiado pronto en la IA. Es recomendable hacer el trabajo de ideación mentalmente antes de abrir la herramienta. La IA puede hacernos perder habilidades cognitivas o capacidades que actualmente tenemos, ya que dejamos de utilizarlas. Es parecido a lo que nos ha pasado con las calculadoras, las agendas de teléfonos móviles o el GPS: hemos perdido capacidad de cálculo y memoria.

–Propiedad intelectual: hay que tener en cuenta que, actualmente, aquello generado exclusivamente por una IA no está protegido por derechos de autor en la mayoría de jurisdicciones; requiere una transformación humana significativa.

Recomendación final en el uso de la IA

Tal como está evolucionando la IA, y aún más según se prevé en el futuro próximo, el factor humano será clave para hacer un buen uso de ella. Como usuarios, y para seguir siendo competitivos profesionalmente, será necesario, ante todo, tener espíritu crítico: cuestionar cualquier resultado e información, mantener la imaginación, querer experimentar con las herramientas, adoptar una actitud de revisión y prudencia, y tener voluntad de profundizar.

También será necesario dedicar tiempo a la formación tanto en IA como en nuestra propia profesión. Por tanto, el éxito de los resultados que obtengamos con la IA en nuestro ámbito profesional dependerá, en gran medida, de la actitud y del comportamiento que tengamos en su uso.

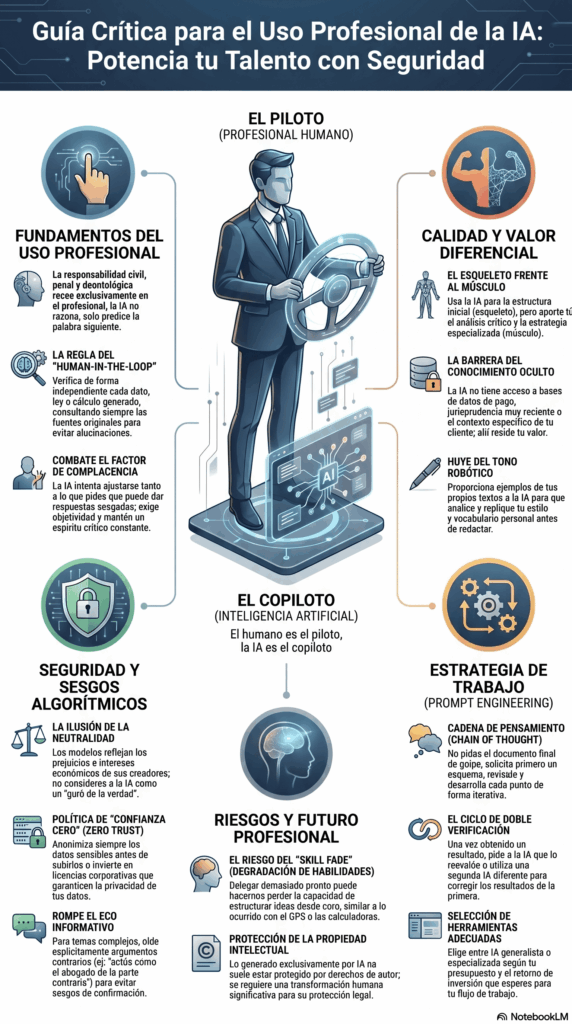

Infografía